Va todo tan rápido con el avance de la tecnología que muchas respuestas van por delante de las propias preguntas. Hace un mes hablábamos del estudio que simuló un conflicto para ver cómo lo resolvían cinco IAs, y cuyo resultado dejaba mucho que desear. Sus resultados también auguraban que el uso de algoritmos en la toma de decisiones directas en conflictos bélicos estaba muy lejos.

También estábamos equivocados.

Al parecer, y como ha contado Bloomberg, el Pentágono ha estado utilizando un programa de algoritmos de visión por computadora para ayudar a identificar objetivos de ataques aéreo. Para ser más exactos, los algoritmos se utilizaron para ayudar a llevar a cabo más de 85 ataques aéreos como parte de una misión en el Medio Oriente (Irak y Siria) el pasado 2 de febrero.

Estos bombardeos “destruyeron o dañaron cohetes, misiles, almacenamiento de drones y centros de operaciones de milicias, entre otros objetivos”, informa el medio. Una ofensiva que fue parte de una respuesta organizada de la administración Biden al ataque con drones de enero en Jordania que mató a tres miembros del servicio estadounidense. El gobierno ha culpado del ataque a agentes respaldados por Irán.

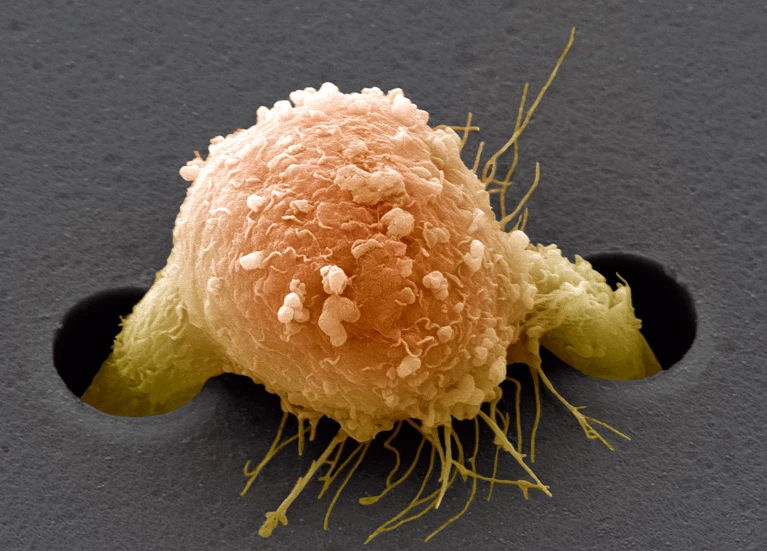

Más datos. El medio también cita a Schuyler Moore, director de tecnología del Comando Central de Estados Unidos, quien dijo sobre el uso de IA por parte del Pentágono: “Hemos estado usando visión por computadora para identificar dónde podría haber amenazas“.

Cuando hablamos de este tipo de tecnología de visión por computadora, como campo, gira en torno al entrenamiento de algoritmos para identificar visualmente objetos particulares. A su vez, estos algoritmos que ayudaron a seleccionar los objeticos con los recientes bombardeos del gobierno se desarrollaron como parte del Proyecto Maven que se lanzó en 2017, un programa diseñado para estimular “un mayor uso de la automatización en todo el Departamento de Defensa”.

Una noticia que nos acerca a una distopía terrorífica y que, quizás, marca el comienzo de algo especialmente grave. Si en el pasado y en el marco de un conflicto bélico se culpaba a un “error humano” ante la muerte de inocentes, ahora lo van a tener realmente fácil: la culpa será siempre de un algoritmo.

Deja un comentario